Искусственный Интеллект (ИИ) продолжает удивлять нас своими возможностями: от создания изображений до написания стихов. Теперь очередь дошла до клонирования речи.

Искусственный Интеллект (ИИ) продолжает удивлять нас своими возможностями: от создания изображений до написания стихов. Теперь очередь дошла до клонирования речи.

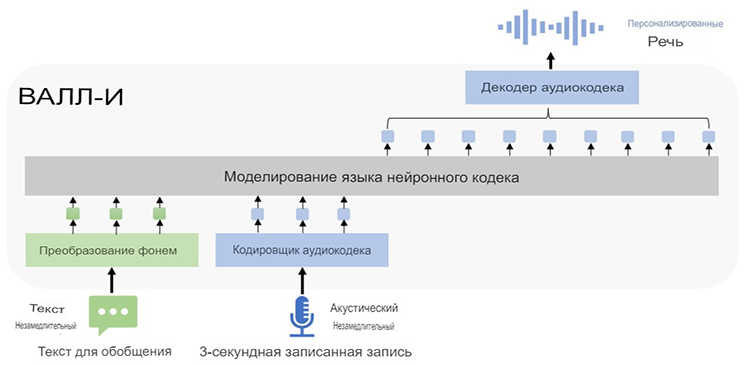

В начале года, команда ученых из Microsoft, опубликовала статью о новой модели языка нейронного кодека под названием VALL-E. Новый ИИ может скопировать любой голос на основе образца говорящего продолжительностью всего три секунды.

Это не первый синтезатор речи, но построен он по совершенно иному принципу, нежели его предшественники.

Отличие от других

Существующие модели преобразования текста, для создания искусственных голосов, используют волновые формы (графическое представление звуковых волн по мере их прохождения через среду с течением времени) настраивая такие характеристики, как тон или высота тона, для приближения к заданному голосу.

В отличии от них, VALL-E берет образец чьего-то голоса и разбивает его на компоненты, называемые токенами, а затем использует их для создания новых звуков на основе «правил», которые он уже узнал об этом голосе. ИИ уловит и сможет воспроизвести все особенности говорящего. Например, если голос низкий, или говорящий картавит, или он более монотонный, чем обычно.

Модель основана на технологии EnCodec от Meta , которая была выпущена в октябре 2022 года. Инструмент использует трехчастную систему для сжатия звука до размера в 10 раз меньшего, чем MP3, без потери качества. Его создатели хотели, чтобы одним из его применений было улучшение качества голоса и музыки при звонках, совершаемых через соединения с низкой пропускной способностью.

Для обучения ВАЛЛ-И его создатели использовали аудиотеку под названием LibriLight , чьи 60 000 часов английской речи в основном состоят из повествования аудиокниг. Модель дает наилучшие результаты, когда синтезируемый голос похож на один из голосов из обучающей библиотеки.

Помимо воссоздания чьего-то голоса, VALL-E может синтезировать персонализированную речь, сохраняя при этом акустическую среду и эмоции из образца говорящего. Клип, записанный по телефону, будет звучать иначе, чем сделанный лично.

Поскольку VALL-E может синтезировать речь, сохраняющую идентичность говорящего, она может нести потенциальные риски при неправильном использовании модели.

Как использовать

Существует бесчисленное множество способов воспользоваться преимуществами этой технологии. Команда, создавшая ВАЛЛ-И, осознает, что ее могут использовать мошенники. Поэтому они воздержались от публичного доступа к коду VALL-E и включили этическое заявление в конец своей статьи.

Когда подобные инструменты попадут не в те руки, скорее всего лишь вопрос времени. Исследователи предполагают, что риски, которые будут представлять такие модели, как VALL-E, можно снизить, создав модели обнаружения, чтобы определить, являются ли аудиоклипы реальными или синтезированными. Нужен ли нам ИИ для защиты от ИИ, покажет время.